Evrimsel Yeniliklerle Desteklenen Devrimsel Performans

NVIDIA DGX B200, AI yolculuklarının herhangi bir aşamasındaki her boyuttaki işletme için geliştirmeden dağıtıma kadar olan boru hatları için birleşik bir AI platformudur. Beşinci nesil NVIDIA NVLink ile birbirine bağlı sekiz NVIDIA Blackwell GPU ile donatılan DGX B200, önceki nesillere göre 3 kat daha fazla eğitim performansı ve 15 kat daha fazla çıkarım performansı sunarak öncü performans sunar. NVIDIA Blackwell GPU mimarisinden yararlanan DGX B200, büyük dil modelleri, öneri sistemleri ve sohbet robotları dahil olmak üzere çeşitli iş yüklerini işleyebilir ve bu da onu AI dönüşümlerini hızlandırmak isteyen işletmeler için ideal hale getirir.

Birleşik Yapay Zeka Performansı

Geliştirmeden Dağıtıma Pipelinelar için Tek Platform

İşletmeler, eğitimden ince ayara ve çıkarıma kadar AI boru hattının her aşamasında karmaşık AI veri kümelerini işlemek için muazzam miktarda hesaplama gücüne ihtiyaç duyar. NVIDIA DGX B200 ile işletmeler, geliştiricilerini iş akışlarını hızlandırmak için oluşturulmuş tek bir platformla donatabilir.

Yapay Zeka Performansının Güç Merkezi

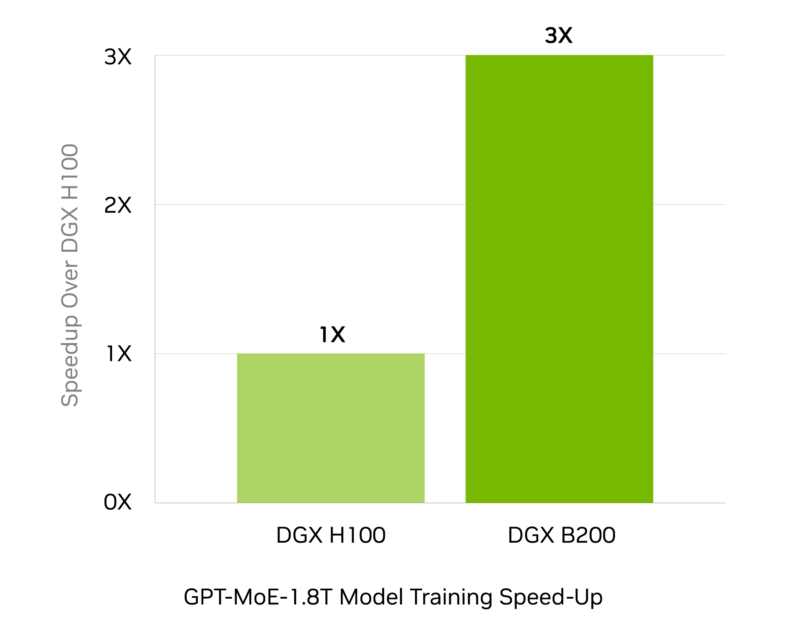

NVIDIA Blackwell mimarisinin hesaplama alanındaki ilerlemeleriyle desteklenen DGX B200, DGX H100’ün 3 katı eğitim performansı ve 15 katı çıkarım performansı sunar. NVIDIA DGX BasePOD™ ve NVIDIA DGX SuperPOD™’un temeli olarak DGX B200, her türlü iş yükü için öncü performans sunar.

Kanıtlanmış Altyapı Standardı

DGX B200, NVIDIA Base Command ve NVIDIA AI Enterprise yazılımları da dahil olmak üzere tüm NVIDIA AI yazılım yığınını, üçüncü taraf desteğinden oluşan zengin bir ekosistemi ve NVIDIA profesyonel hizmetlerinden uzman tavsiyelerine erişimi içeren tamamen optimize edilmiş bir donanım ve yazılım platformudur.

Daha Hızlı Yenilik Yapın

Yüksek başarımlı hesaplama (HPC), üretkenliğinizi hızlandırır. Böylece yazılımınız daha hızlı bir şekilde ürüne dönüşür.

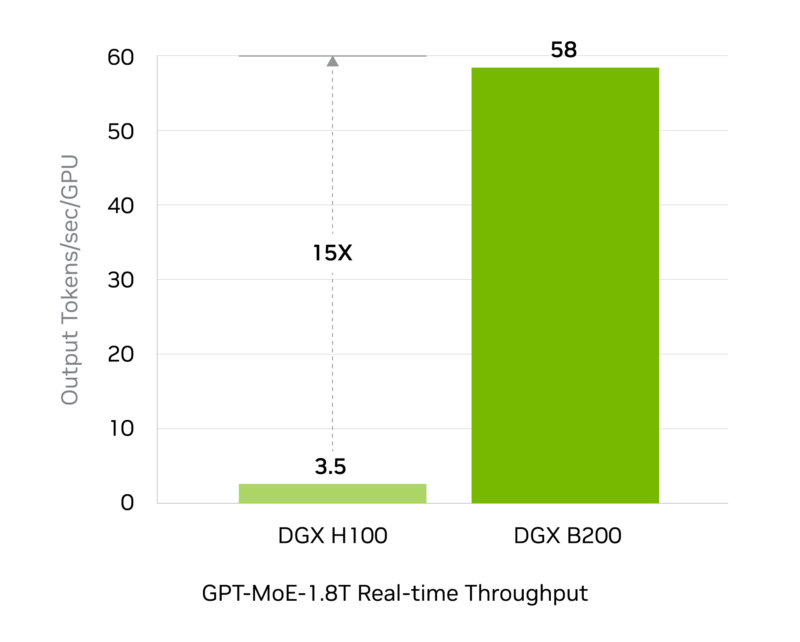

Gerçek Zamanlı LLM Çıkarımı

Projected performance subject to change. Token-to-token latency (TTL) = 50ms real time, first token latency (FTL) = 5s, input sequence length = 32,768, output sequence length = 1,028, 8x eight-way DGX H100 GPUs air-cooled vs. 1x eight-way DGX B200 air-cooled, per GPU performance comparison.

Süper Şarjlı AI Eğitim Performansı

Projected performance subject to change. 32,768 GPU scale, 4,096x eight-way DGX H100 air-cooled cluster: 400G IB network, 4,096x 8-way DGX B200 air-cooled cluster: 400G IB network.

Özellikler

| GPU | 8x NVIDIA Blackwell GPUs |

|---|---|

| GPU Belleği | 1,440GB total GPU memory |

| Performans | 72 petaFLOPS training and 144 petaFLOPS inference |

| Güç Tüketimi | 14.3kW max |

| CPU | 2 Intel® Xeon® Platinum 8570 Processors 112 Cores total, 2.1 GHz (Base), 4 GHz (Max Boost) |

| Sistem Belleği | 4TB’a kadar |

| Ağ | 4x OSFP ports serving 8x single-port NVIDIA ConnectX-7 VPI Up to 400Gb/s InfiniBand/Ethernet 2x dual-port QSFP112 NVIDIA BlueField-3 DPU Up to 400Gb/s InfiniBand/Ethernet |

| Yönetim Ağı | 10Gb/s onboard NIC with RJ45 100Gb/s dual-port ethernet NIC Host baseboard management controller (BMC) with RJ45 |

| Depolama | OS: 2x 1.9TB NVMe M.2 Internal storage: 8x 3.84TB NVMe U.2 |

| Yazılım | NVIDIA AI Enterprise: Optimized AI Software NVIDIA Base Command: Orchestration, Scheduling, and Cluster Management DGX OS / Ubuntu: Operating system |

| Rack Unıts (RU) | 10 RU |

| Sistem Boyutları | Height: 17.5in (444mm) Width: 19.0in (482.2mm) Length: 35.3in (897.1mm) |

| Çalışma Sıcaklığı | 5–30°C (41–86°F) |

| Kurumsal Destek | Donanım ve yazılım için üç yıllık Kurumsal İş Standardı Desteği 7/24 Kurumsal Destek portalı erişimi Yerel iş saatleri içerisinde canlı temsilci desteği |