Tavsiye Sistemli İş Akışları için Tasarlandı

Merlin, uçta yüksek performanslı öneri sistemleri yapabilmek için veri bilimcilere, makine öğrenimi mühendislerine ve araştırmacılara ihtiyaç duydukları gücü sağlar. Merlin, ortak ön işleme, özellik mühendisliği, eğitim ve çıkarım zorluklarını ele alarak derin öğrenme öneri sistemleri oluşturmayı demokratikleştiren kütüphaneler, yöntemler ve araçlar içerir. Merlin veri yolunun her bir komponenti, kullanımı kolay API’ler ile erişilebilen yüzlerce terabaytlık veriyi destekleyebileceği şekilde optimize edilmiştir. Merlin ile geleneksel yöntemlerden daha iyi tahminler ve artan tıklama oranlarına kolayca erişebilirsiniz.

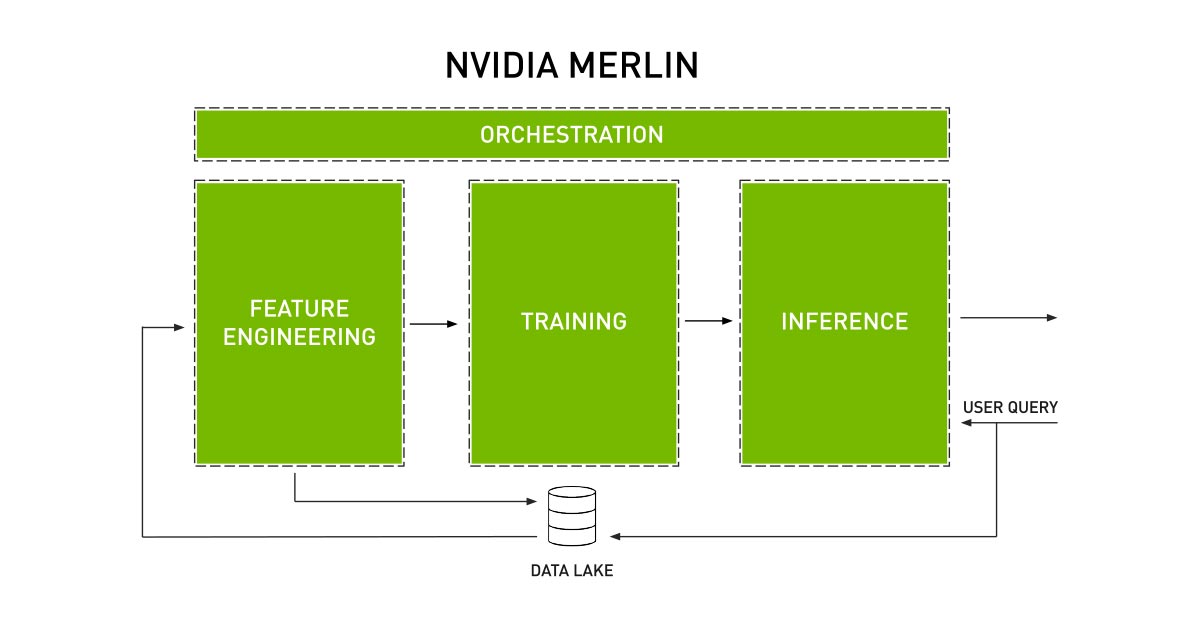

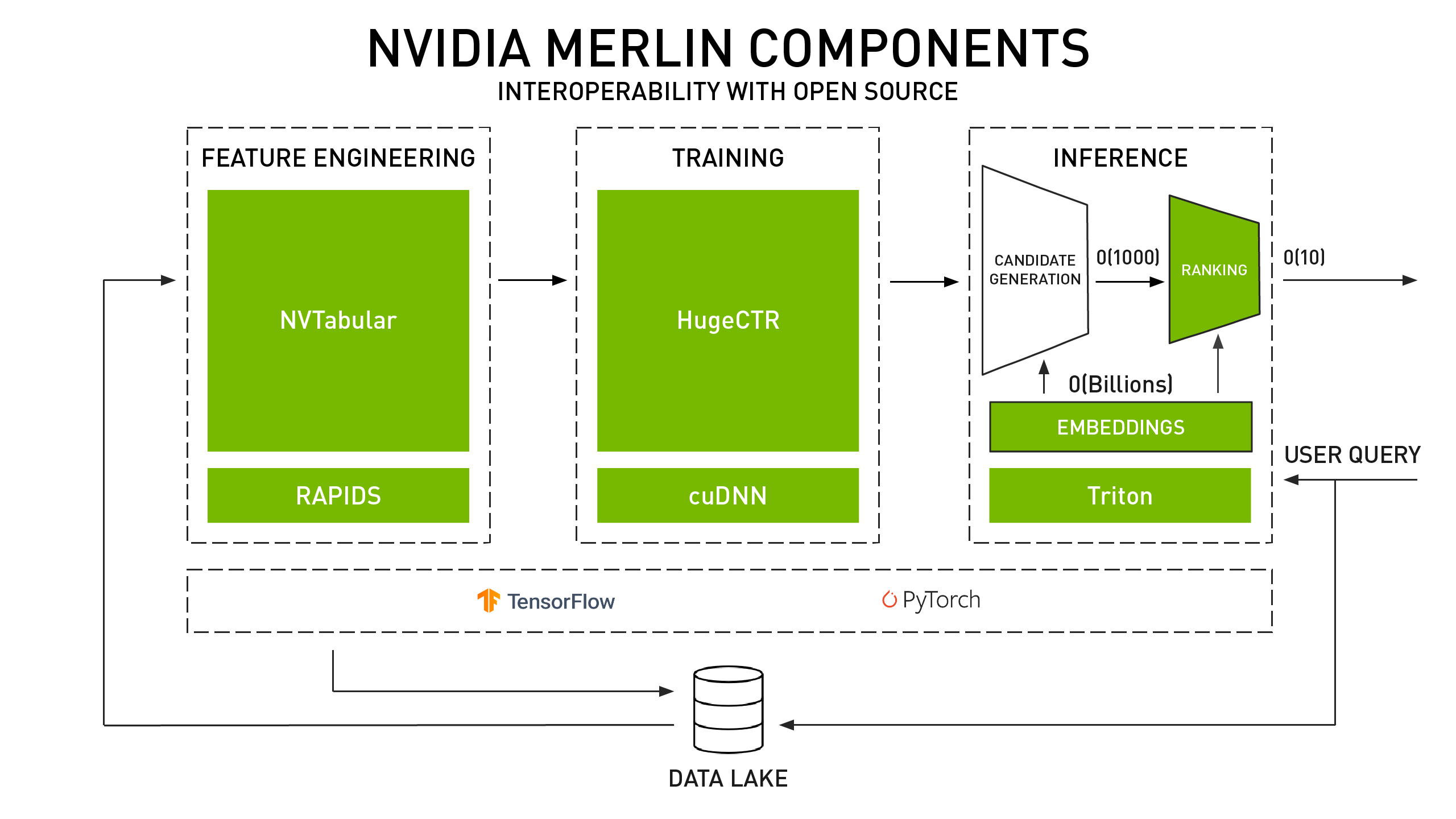

UÇTAN UCA REFERANS MİMARİ

NVIDIA Merlin, veri alımı ve eğitimden GPU hızlandırmalı öneri sistemlerinin çalıştırılmasına kadar bütün veri yolunu hızlandırır. Merlin’in açık kaynaklı komponentleri, üretim kalitesinde bir veri hattı oluşturmayı ve dağıtmayı çok kolay bir hale getirir.

NVTabular

Merlin NVTabular, terabaytlarca öneri sistemi veri setini etkili bir şekilde işlemek ve veri hazırlama süresini önemli ölçüde azaltmak için tasarlanmış bir özellik mühendisliği ve ön işleme kütüphanesidir.

Hemen Deneyin:

NVTabular

Merlin NVTabular, terabaytlarca öneri sistemi veri setini etkili bir şekilde işlemek ve veri hazırlama süresini önemli ölçüde azaltmak için tasarlanmış bir özellik mühendisliği ve ön işleme kütüphanesidir.

Hemen Deneyin:

HugeCTR

Merlin HugeCTR, tavsiye sistemleri için tasarlanan bir derin nöral ağ eğitim kütüphanesidir. Maksimum performans için birden fazla GPU ve düğümde paralel model gömülü tabloları ve veri paralel sinir ağları ile dağıtılmış eğitim sağlar.

Hemen Deneyin:

HugeCTR

Merlin HugeCTR, tavsiye sistemleri için tasarlanan bir derin nöral ağ eğitim kütüphanesidir. Maksimum performans için birden fazla GPU ve düğümde paralel model gömülü tabloları ve veri paralel sinir ağları ile dağıtılmış eğitim sağlar.

Hemen Deneyin:

TensorRT ve Triton

Doğru GPU kullanımı ve gecikme kombinasyonu ile verimi en üst düzeye çıkararak GPU’larda çıkarımı verimli bir şekilde çalıştırmak için NVIDIA Triton™ Inference Server ve NVIDIA® TensorRT™’den yararlanın.

Hemen Deneyin:

TensorRT ve Triton

Doğru GPU kullanımı ve gecikme kombinasyonu ile verimi en üst düzeye çıkararak GPU’larda çıkarımı verimli bir şekilde çalıştırmak için NVIDIA Triton™ Inference Server ve NVIDIA® TensorRT™’den yararlanın.

Hemen Deneyin: